-

Produkte und Dokumentation Red Hat AI

Eine Plattform mit Produkten und Services für die Entwicklung und Bereitstellung von KI in der Hybrid Cloud.

Red Hat AI Enterprise

Erstellen, entwickeln und stellen Sie KI-gestützte Anwendungen in der Hybrid Cloud bereit.

Red Hat AI Inference Server

Optimieren Sie die Modell-Performance mit vLLM für schnelle und kosteneffiziente Inferenz in großem Umfang.

Red Hat Enterprise Linux AI

Entwickeln, testen und führen Sie generative KI-Modelle mit optimierten Inferenzfunktionen aus.

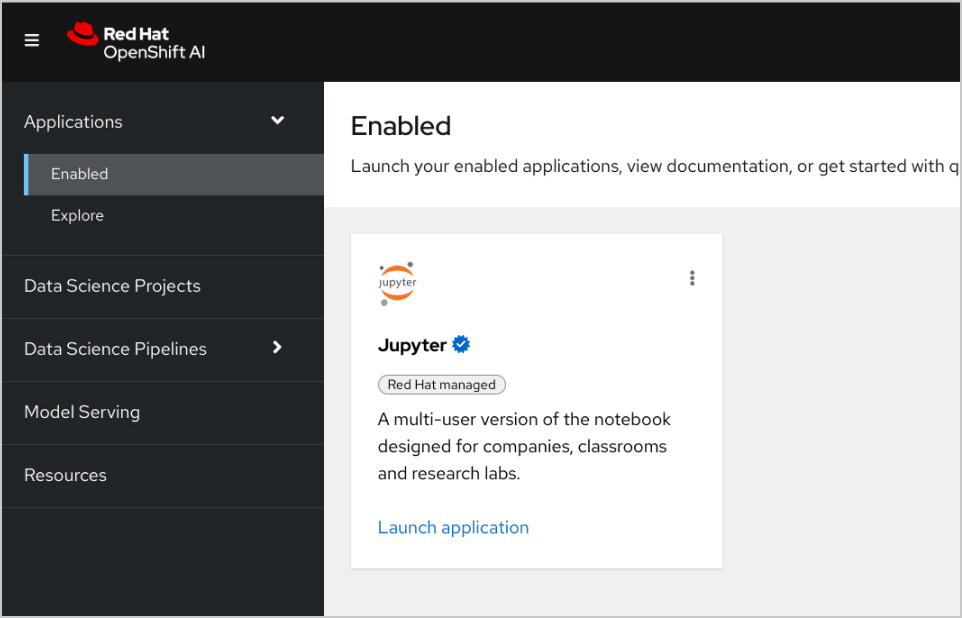

Red Hat OpenShift AI

Entwickeln und implementieren Sie KI-gestützte Anwendungen und Modelle in großem Umfang in Hybrid-Umgebungen.

-

Lernen Grundlagen

-

KI-Partner

Red Hat OpenShift AI

Red Hat® OpenShift AI® ist eine Plattform, mit der Sie den Lifecycle prädiktiver und generativer KI-Modelle (gen KI) in großem Umfang in Hybrid Cloud-Umgebungen verwalten können.

Was ist Red Hat OpenShift AI?

OpenShift AI basiert auf Open Source-Technologien und bietet zuverlässige, operativ konsistente Funktionen, mit denen Teams experimentieren, Modelle bereitstellen und innovative Anwendungen liefern können.

Mit OpenShift AI können Sie Daten erfassen und vorbereiten, Modelltraining und Fine Tuning durchführen, Modelle bereitstellen und überwachen sowie auf Hardwarebeschleuniger zugreifen. Durch das offene Partnernetzwerk für Hardware und Software verfügt OpenShift AI über die Flexibilität, die Sie für Ihre speziellen Use Cases benötigen.

KI-gestützte Anwendungen schneller produzieren

Hier sind die bewährten Features von Red Hat OpenShift AI und Red Hat OpenShift in einer unternehmensgerechten KI-Anwendungsplattform vereint, die Ihre Teams zusammenbringt. Data Scientists, Engineers und Anwendungsentwicklungsteams können so in einem Medium zusammenarbeiten, das Konsistenz, Sicherheit und Skalierbarkeit fördert.

Das neuste Release von OpenShift AI umfasst eine kuratierte Sammlung an optimierten, produktionsbereiten Drittanbietermodellen, die für Red Hat OpenShift AI validiert wurden. Dieser Katalog mit Modellen von Drittanbietern bietet Ihrem Team mehr Kontrolle über die Zugänglichkeit und Transparenz von Modellen, was die Einhaltung von Richtlinien und Sicherheitsanforderungen vereinfacht.

Darüber hinaus unterstützt OpenShift AI Sie mithilfe eines optimiertem vLLM-Frameworks dabei, die Kosten von Inferenzen mit verteilter Bereitstellung besser zu managen. Um die operative Komplexität noch weiter zu reduzieren, bietet die Lösung fortschrittliche Tools zum Automatisieren von Deployments und zum Self Service-Zugriff auf Modelle, Tools und Ressourcen.

Features und Vorteile

Weniger Zeitaufwand für das KI-Infrastrukturmanagement

Sichern Sie sich On-Demand-Zugriff auf leistungsstarke Modelle, die Self Service, Skalierung und Deployments erleichtern. Entwicklungsteams können sich der Komplexität entledigen und Kosten optimieren, ohne Abstriche bei der Kontrolle machen zu müssen.

Features wie Models as a Service (MaaS) sind aktuell als Entwicklungsvorschau verfügbar. Der Ansatz mit Fokus auf KI-Zugriff in Form von API-Endpunkten ermöglicht eine private und schnellere KI in großem Umfang.

Getestete und unterstützte KI/ML-Tools

Red Hat testet, integriert und unterstützt KI/ML-Tools und -Modellbereitstellungen, damit Sie sich um Wichtigeres kümmern können. OpenShift AI profitiert von mehreren Jahren Erfahrung mit dem Community-Projekt „Open Data Hub“ und mit Open Source-Projekten wie Kubeflow.

Dank unserer Erfahrung und Open Source-Expertise können wir eine gen KI-bereite Basis bereitstellen, die unseren Kunden mehr Auswahl und Zuversicht bei ihren gen KI-Strategien gibt.

Flexibilität in der gesamten Hybrid Cloud

Red Hat OpenShift AI ist als selbst gemanagte Software und als vollständig gemanagter Cloud Service zusätzlich zu OpenShift verfügbar. Bei dieser sicheren und flexiblen Plattform können Sie selbst entscheiden, wo Sie Ihre Modelle entwickeln und bereitstellen möchten: On-Premise, in der Public Cloud oder sogar am Edge.

Einsatz von Best Practices

Red Hat Services bietet Fachwissen, Training und Support, damit Sie die Herausforderungen von KI meistern können – unabhängig davon, an welchem Punkt der KI-Einführung Ihr Unternehmen sich befindet.

Sie wollen Prototypen für Ihre KI-Lösungen erstellen, das Deployment Ihrer KI-Plattform optimieren oder Ihre MLOps-Strategien voranbringen? Red Hat Consulting bietet Ihnen Support und Mentoring für diese Initiativen und mehr.

KI-Schnellstarts

Es gibt eine Vielzahl innovativer KI-Use Cases in unserer Community. Diese einfachen, gezielten Beispiele wurden für eine schnelle und unkomplizierte Bereitstellung auf der Plattform von Red Hat AI entwickelt.

Well-lit Paths für Entwicklungsteams mit llm-d

Red Hat OpenShift AI umfasst llm-d, ein Open Source Framework, mit dem Sie die Herausforderungen verteilter KI-Inferenz in großem Umfang lösen können.

Das Skalieren von Modellen für eine verteilte Flotte von GPUs bietet ein neues Maß an Kontrolle und Beobachtbarkeit. Dabei können Unternehmen komplexe LLMs in großem Umfang optimieren, indem sie die Inferenz-Pipeline in modulare, intelligente Services zerteilen.

MCP-Server für Red Hat OpenShift AI

In unserer kuratierten Sammlung finden Sie verschiedenste MCP-Server unsere Technologiepartner, die sich mit Red Hat OpenShift AI integrieren lassen.

MCP (Model Context Protocol) ist ein Open Source-Protokoll, das eine 2-Wege-Verbindung und die standardisierte Kommunikation zwischen KI-Anwendungen und externen Services ermöglicht.

Jetzt können Sie diese MCP-Server nutzen, um Unternehmenstools und -ressourcen in Ihre KI-Anwendungen und agentischen Workflows zu integrieren.

Optimierung mit vLLM für schnelle und kosteneffiziente Inferenz

Red Hat AI Inference Server ist Teil der Red Hat AI Plattform. Die Lösung ist in Red Hat Enterprise Linux® AI und in Red Hat OpenShift® AI enthalten, kann aber auch als Standalone-Produkt gekauft werden.

Individuelle KI-Lösungen für Ihre Anforderungen

Generative KI

Neue Inhalte wie Text und Softwarecode produzieren

Mit Red Hat AI können Sie die generativen KI-Modelle Ihrer Wahl schneller, mit weniger Ressourcen und geringeren Inferenzkosten ausführen.

Prädiktive KI

Muster erkennen und zukünftige Ergebnisse prognostizieren

Mit Red Hat AI können Unternehmen prädiktive Modelle entwickeln, trainieren, bereitstellen und überwachen und dabei die Konsistenz in der Hybrid Cloud wahren.

Operationalisierte KI

Systeme entwickeln, die die Wartung und Bereitstellung von KI in großem Umfang unterstützen

Mit Red Hat AI können Sie den Lifecycle von KI-fähigen Anwendungen managen und überwachen, gleichzeitig Ressourcen einsparen und die Compliance mit Datenschutzbestimmungen sicherstellen.

Agentische KI

Entwickeln Sie Workflows, die komplexe Aufgaben unter eingeschränkter Überwachung ausführen.

Red Hat AI bietet einen flexiblen Ansatz und eine stabile Basis für die Entwicklung, Verwaltung und Bereitstellung agentischer KI-Workflows in vorhandenen Anwendungen.

Partnerschaften

Holen Sie mehr aus der Red Hat OpenShift AI Plattform heraus, indem Sie sie um zusätzliche integrierte Services und Produkte erweitern.

NVIDIA und Red Hat bieten Kunden eine skalierbare Plattform, die eine Vielzahl von Use Cases für KI mit unvergleichlicher Flexibilität beschleunigt.

Intel® und Red Hat unterstützen Organisationen dabei, die Einführung von KI zu beschleunigen und ihre KI/ML-Modelle schnell zu operationalisieren.

IBM und Red Hat bieten Open Source-Innovationen zur Beschleunigung der KI-Entwicklung, unter anderem durch IBM watsonx.aiTM, einem unternehmensgerechten KI-Studio für KI-Entwicklungsteams.

Starburst Enterprise und Red Hat unterstützen verbesserte und zeitgerechtere Erkenntnisse durch schnelle Datenanalysen auf mehreren verschiedenen und verteilten Datenplattformen.

Zusammenarbeit über Modell-Workbenches

Mit AI Hub und Gen AI Studio können Platform Engineers und AI Engineers gen KI-Modelle in Zusammenarbeit schneller in die Produktion bringen.

AI Hub ermöglicht Platform Engineers das Management von LLMs mit zentralen KI-Workloads und Insights zur Performance durch die Validierung von Drittanbietermodellen. Gen Ai Studio bietet AI Engineers eine praktische Umgebung, in der sie mit Modellen interagieren und schnell Prototypen von gen KI-Anwendungen erstellen können. Durch den Zugang zu einer Sandbox können die Teams die Eignung von Modellen vor der Lifecycle-Integration prüfen und mit Chat- und RAG-Workflows (Retrieval-Augmented Generation) experimentieren.

Außerdem haben Data Scientists Zugriff auf vorab erstellte oder benutzerdefinierte Cluster Images und können so mit den Modellen arbeiten, die ihre bevorzugten IDEs und Frameworks nutzen. Red Hat OpenShift AI verfolgt Änderungen an Jupyter, PyTorch, Kubeflow und anderen Open Source-basierten KI-Technologien.

Deployment und Sicherheit von Modellen mit Red Hat OpenShift AI skalieren

Sie können Modelle mit einer optimierten Version von vLLM (oder anderen Modellservern Ihrer Wahl) bereitstellen, um sie so in KI-fähige Anwendungen zu integrieren – On-Premise, in der Public Cloud oder am Edge. Diese Modelle lassen sich basierend auf Änderungen am Quell-Notebook neu erstellen, bereitstellen und überwachen.

Halluzinationen und Verzerrungen können die Integrität Ihrer Modelle beeinträchtigen und das Skalieren erschweren. OpenShift AI ermöglicht Datenteams das Monitoring von Modellausgaben und Trainingsdaten auf Übereinstimmung, um für Fairness, Sicherheit und Skalierbarkeit zu sorgen.

Livedaten, die für Modellinferenz verwendet werden, werden mit speziellen Tools überwacht, um Abweichungen (Drift) von den ursprünglichen Trainingsdaten zu erkennen. Die enthaltenen KI-Richtlinien tragen zum Schutz Ihrer Modellein- und -ausgaben vor schädlichen Daten wie beleidigenden und anstößigen Äußerungen, personenbezogenen Daten oder anderen domainspezifischen Einschränkungen bei.

Weitere KI Success Stories vom Red Hat Summit und AnsibleFest 2025

Turkish Airlines verdoppelte die Geschwindigkeit der Bereitstellung durch unternehmensweiten Zugang zu Daten.

JCCM konnte die Prozesse zur Umweltverträglichkeitsprüfung (UVP) in der Region mithilfe von KI verbessern.

Die Denizbank verkürzte die Markteinführungszeiten von Tagen auf wenige Minuten.

Hitachi hat KI in seinem gesamten Unternehmen mit Red Hat OpenShift AI operationalisiert.

Möglichkeiten zum Testen von Red Hat OpenShift AI

Developer Sandbox

Für Entwicklungsteams und Data Scientists, die KI-fähige Anwendungen in einer vorkonfigurierten und flexiblen Umgebung entwickeln und damit experimentieren wollen.

60-tägige Testversion

Ihr Unternehmen will die Möglichkeiten von OpenShift AI umfassend testen? Nutzen Sie unsere 60-tägige Testversion. Sie benötigen dazu einen Red Hat OpenShift Cluster.